Image typique des années 1980 : dallage, sphère, reflets et une image de fond (les nuages).

La synthèse d'images est une des disciplines de l'infographie, elle consiste en la création assistée par ordinateur d'images numériques. Ces images sont appelées « images de synthèse ».

Si la qualité et la puissance des matériels informatiques sur lesquels les premières images ont été conçues (dans les années 1960), que ce soit pour le calcul des images ou pour leur affichage, ne permettaient pas le photoréalisme, la grande tendance des années 1980 fut vers un certain photoréalisme. Celle-ci étant quasiment atteinte dans les années 1990 (en temps différé), voire en temps réel (années 2000), on observe un retour à une certaine liberté graphique dans la conception des images.

Au cinéma

Dès 1973, Peter Földes produit au Canada un certain nombre de courts-métrages animés par ordinateur, comme La Faim.

En 1976, Les Rescapés du futur (Futureworld), suite de Mondwest (1973), est le premier long-métrage à intégrer des images de synthèse 3D à son récit.

En 1982, Tron est le premier film à mélanger images réelles et images créées ou retouchées par ordinateur.

En 1983, Maison vol Sogitec Ina 1er court metrage français diffusé

En 1983, Humanonon by michel françois music by Alain Guelis.

En 1985, Tony de Peltrie, film qui fait apparaître une charge émotionnelle forte.

En 1986, John Lasseter, qui a réalisé le premier court-métrage entièrement en images de synthèse, Luxo Jr. est nommé aux Oscars.

En 1995, il récidive avec Toy Story, le premier des longs-métrages, pour lequel il reçoit un Oscar.

En 1998, Vache Folle Sup info com school france

En 1998, Sup info com school france

Enfin en 2001, Final Fantasy : les Créatures de l'esprit est le premier long-métrage ambitionnant le photoréalisme.

Grands noms

Ivan Sutherland, le précurseur et son système interactif Sketchpad ;

Pierre Bézier chez Renault, où il inventa les courbes qui portent son nom, utilisées en CAO ;

Paul de Casteljau chez Citroën, qui inventa un algorithme de calcul des courbes de Bézier ;

Benoît Mandelbrot découvrant les propriétés fractales, utilisées en simulation de plantes, terrains, et autres phénomènes complexes ;

Henri Gouraud pour son algorithme d'ombrage ;

Bui Tuong Phong travaillant à l'INRIA, où il créa son algorithme d'illumination et, avec quelques autres chercheurs, une pré-version de ce qui allait devenir OpenGL ;

Jack E. Bresenham pour ses algorithmes de tracé de segment et de cercle, basés sur des opérations entières.

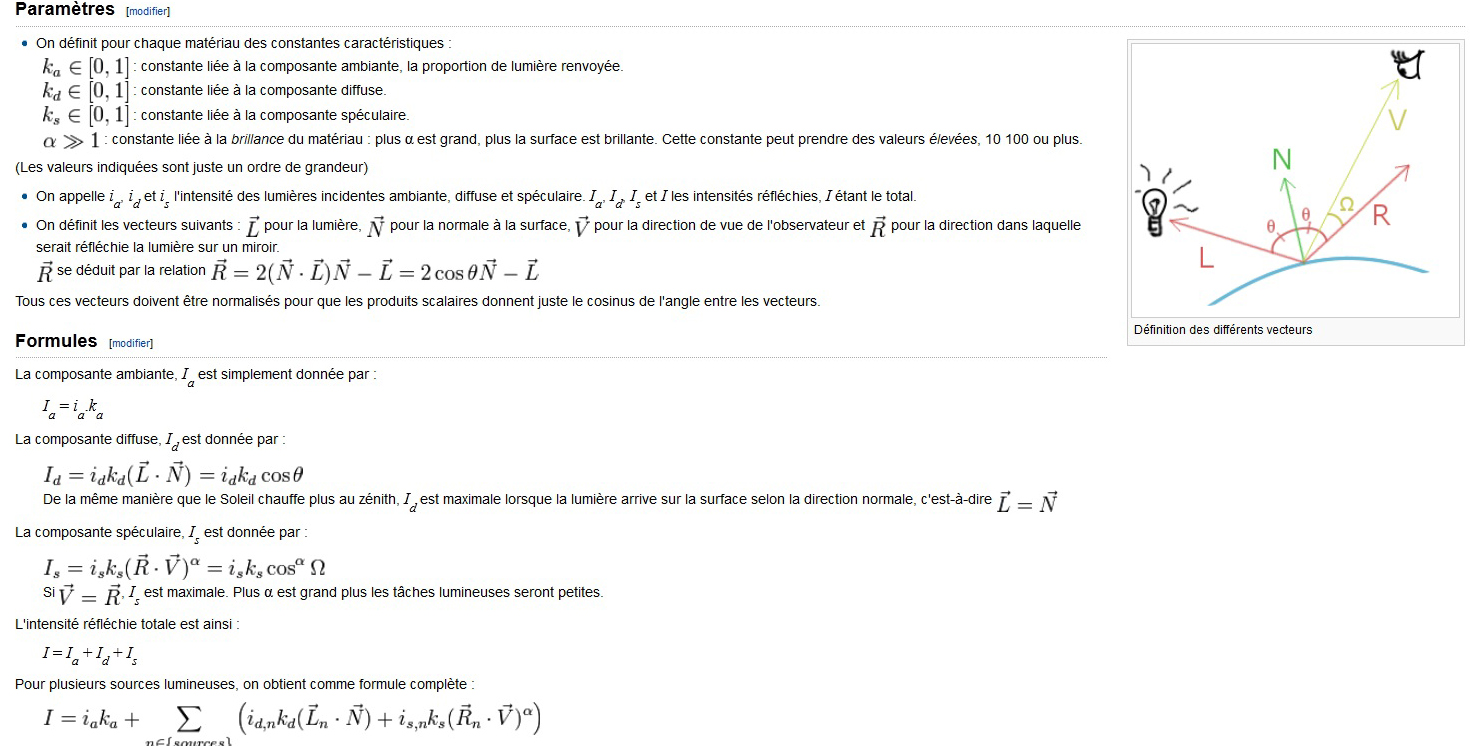

Modèle d'illumination de Phong

Définition des différents vecteur

Lorsqu'on souhaite appliquer cet algorithme en infographie, on sépare les composantes rouge/vert/bleu de la couleur de la texture pour le point considéré. Puis on applique la formule à id = is = icouleur pour les trois couleurs.

La composante spéculaire se base sur deux vecteurs directionnels, l'observateur et la lumière, et interdit toute radiosité du modèle. Ce modèle est empirique et n'est fondé sur aucune théorie physique, mais uniquement sur les observations de Phong. Ce modèle ne prévoit pas la diffusion de la lumière avec la distance

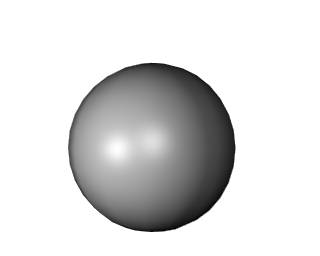

Une sphère interpolée et rendue selon Phong

Cette méthode, à mettre en parallèle avec l'interpolation de Gouraud, produit de bons résultats de rendus, souvent plus réalistes que son prédécesseur.

Le principal problème de l'ombrage de Gouraud, c'est qu'il ne calcule que les sommets (vertex) des polygones : une source lumineuse spéculaire placée au centre d'un triangle n'apparaîtra pas. Ce problème est réglé avec l'interpolation de Phong.

Soient trois sommets distincts : v1, v2 et v3, ayant pour vecteurs unitaires normaux n1, n2 et n3. Comme pour l'interpolation de Gouraud, celle-ci se fait de façon linéaire sur toute la surface du triangle v1v2v3, seulement elle se fait depuis les trois vecteurs normaux des sommets, c'est-à-dire que nous interpolons en fait les vecteurs normaux au lieu des couleurs.

À la différence de l'interpolation de Gouraud cependant, le calcul ne se fait pas sur 3 points par surface, mais pour tous les points d'une surface - ou plus raisonnablement, sur plusieurs subdivisions de points. Cette méthode, bien plus lente, est parfois traitée par le matériel directement, via les shaders.

Images de synthèse : palme de la longévité pour l’ombrage de Gouraud

L'histoire de l'invention de « l'ombrage de Gouraud », que tous les infographistes connaissent bien, est l'occasion de revenir sur l'histoire des images de synthèse. D'autant plus que, fait rare dans l'histoire de l'informatique, 40 ans après, elle est toujours d'actualité.

Dans le monde informatique, combien de méthodes algorithmiques résistent à l'usure du temps ? Assurément très peu, les chercheurs et les développeurs améliorant en permanence les performances des solutions existantes, ou bien en inventant de nouvelles. Il y a au moins une exception à ce constat, une innovation qui, malgré l'augmentation de la puissance des ordinateurs et l'évolution des logiciels, reste d'actualité, toujours utilisée depuis bientôt... 40 ans ! Et pas dans n'importe quel domaine : celui des images de synthèse, et par conséquent dans ceux des jeux vidéos, des effets spéciaux du cinéma, de la conception assistée par ordinateur (CAO) dans l'industrie automobile, aéronautique ou aérospatiale, des logiciels d'architecture, de la réalité virtuelle...

« Il n'y a qu'une seule explication à cela, avance discrètement Henri Gouraud, l'inventeur de la technique de rendu des images de synthèse 3D qui porte son nom : elle était à l'époque et elle reste aujourd'hui encore la technologie la plus simple, la plus économique pour obtenir des images 3D quasi-réalistes, en temps réel. » Elle est même utilisée aujourd'hui dans toutes les cartes graphiques 3D du marché des ordinateurs. Cela ne durera peut-être pas encore plusieurs décennies, car les technologies d'informatique graphique plus sophistiquées, beaucoup plus réalistes encore, profitent de la puissance des ordinateurs. Mais la prouesse n'en reste pas moins remarquable.

Revenons donc quelques années en arrière, lorsqu'en septembre 1968, Henri Gouraud, jeune homme de 24 ans, traverse l'Atlantique sur les conseils d'un de ses professeurs de Sup'Aéro pour rejoindre le département Informatique de l'Université de l'Utah (Salt Lake City) et l'équipe d'Ivan Sutherland. « L'informatique graphique m'intéressait, raconte Henri Gouraud. Parce que c'était concret : on voyait ce qu'on faisait. Mais je n'y connaissais rien. J'avais seulement fait du Fortran et du calcul numérique à l'Ecole Centrale, et commencé à découvrir l’informatique dans ma spécialisation Automatique et Informatique à Sup'Aéro. »

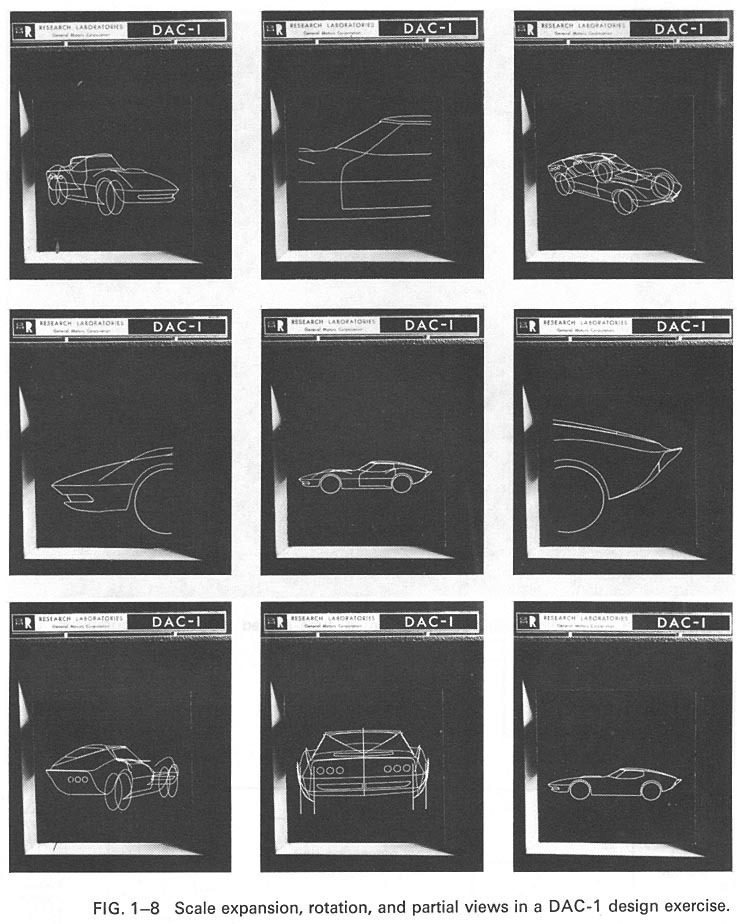

En revanche, Ivan Sutherland avait, quant à lui, déjà une certaine notoriété en la matière. Pionnier de ce domaine, au début des années 1960, il avait développé au Massachusetts Institute of Technology (MIT) ce qui est considéré comme la première application interactive graphique : Sketchpad ![]() . Ses travaux, publiés dans sa thèse, en 1963, décrivent les principes fondamentaux de l'infographie 3D et du vaste domaine de la conception assistée par ordinateur, la CAO, autrement dit le prototypage virtuel, qui deviendra, en quelques décennies, le modèle pour la conception de toute l'industrie automobile et aéronautique. Il propose à Henri Gouraud de travailler dans cette voie, sur la conception et la manipulation par ordinateur, en temps réel, d'objets 3D complexes, comme des pièces de structure automobile.

. Ses travaux, publiés dans sa thèse, en 1963, décrivent les principes fondamentaux de l'infographie 3D et du vaste domaine de la conception assistée par ordinateur, la CAO, autrement dit le prototypage virtuel, qui deviendra, en quelques décennies, le modèle pour la conception de toute l'industrie automobile et aéronautique. Il propose à Henri Gouraud de travailler dans cette voie, sur la conception et la manipulation par ordinateur, en temps réel, d'objets 3D complexes, comme des pièces de structure automobile.

Quel était le contexte ? La synthèse d'images, création d'images numériques par ordinateur, était dans les limbes. Jusqu'à la fin des années 1960, ordinateurs et écrans d'affichage étaient évidemment à des années lumière des matériels actuels. Néanmoins, les bases de la modélisation des images étaient déjà posées. Le calcul par ordinateur de l'image d'un objet (que ce soit un capot de voiture, un avion ou un visage) repose sur la définition de sa forme à l'aide d'un modèle géométrique. Chaque objet peut être représenté par des facettes, des polygones, triangles, rectangles... qui décrivent l'enveloppe extérieure de n'importe quel solide.

|

À partir d'une structure en fil de fer, quelle est la face avant ? |

À l'écran, cela se traduit par une juxtaposition de facettes représentées par leurs arêtes, ce qu'on appelle « la structure en fil de fer ». On voit tout simplement toutes les facettes que l'ordinateur a calculées. Prenons l'exemple d'un dé : son modèle numérique s'affiche avec ses six faces, comme s'il était transparent. L'intérêt de cette représentation simple est qu'elle pouvait être affichée en temps réel, avec le matériel de l'époque. Il existait des écrans (ADAGE, Tektronix...) que l'on utilisait un peu comme des tables à dessiner, en traçant des lignes, composant ainsi un dessin vectoriel dont les équations étaient décrites dans l'ordinateur, et que l'on pouvait ensuite manipuler, en modifier la longueur... « Mais dès que les objets dessinés étaient complexes, on n'y comprenait plus rien, les tracés des faces avant et arrière se mélangeaient » explique Henri Gouraud.

Beaucoup de recherches visaient, à ce moment là, à résoudre ce problème d'affichage, pour que seules les faces visibles de l'objet soient affichées, qu'on ne voie plus au travers. En particulier, le français Philippe Loutrel à New York avait publié une thèse sur ce sujet en 1967. Sa méthode de résolution faisait néanmoins appel à des calculs complexes qui posaient de délicats problèmes de précision. À l’Université de l'Utah, le directeur du département David Evans avait proposé une approche fondamentalement différente, beaucoup plus simple : effectuer les calculs non plus dans l'espace géométrique de l'objet – où la précision des nombres en question définit la précision du résultat – mais en fonction de l'écran – où la précision est dictée par sa résolution, c'est à dire le pixel. La thèse de John Warnock, également à l'université de l'Utah en 1969, a été la première à mettre en œuvre cette approche qui permettait en plus une représentation plus naturelle des objets, avec un aspect volumique, solide, une image opaque, bien plus réaliste.

« Mais ces images solides, comme celles sur lesquelles travaillait John Warnock, étaient bien plus longues à calculer, rappelle Henri Gouraud. Du coup, l'affichage était très lent. On devait utiliser un appareil photo, en pause pendant deux minutes devant l'écran, pour capter l'image complète ! » Les mémoires d'écran n'existaient pas encore. Les ordinateurs n'étaient pas capables de conserver les images calculées au fur et à mesure et de les afficher en balayage comme le font les écrans de télévision, au rythme d'une image tous les 1/30e de seconde. Justement, un autre thésard du labo, Gary Watkins, concevait un matériel d'affichage d'objets solides, en temps réel sur un écran de type TV. Sa technique était basée sur une comparaison des facettes entre elles pour déterminer leurs points d'intersection, éliminer les facettes cachées... « Tout à fait ce dont j'avais besoin » résume Henri Gouraud.

Restait néanmoins un problème de taille : « Pour représenter les pièces complexes auxquelles je m'intéressais, les facettes étaient trop anguleuses, poursuit Henri Gouraud. Je souhaitais utiliser des surfaces courbes comme celles proposées quelques années plus tôt par Coons ou Bézier. » Les surfaces (ou « carreaux ») de Bézier, inventées en 1962 par les ingénieurs français Paul de Casteljau (Citroën) et Pierre Bézier (Renault), permettaient de concevoir par ordinateur la surface de pièces de carrosseries par exemple. Le modèle était ensuite intégré dans une machine à commande numérique pour être usiné dans une mousse que l'on pouvait peindre pour avoir une idée réaliste de la pièce. Citroën et Renault étaient d'ailleurs précurseurs en CAO mais on était loin des applications interactives.

« Sauf que pour pouvoir tirer profit des algorithmes de John Warnock et de Gary Watkins pour supprimer les faces cachées et utiliser l'affichage en mode TV, il me fallait décomposer chaque surface de Bézier en une collection de facettes, reprend Henri Gouraud. Ce qui redonnait immanquablement un aspect anguleux à mes images. »

En effet, l'ombrage plat alors utilisé consistait simplement à affecter à chacune des facettes de l'objet un éclairement fonction de l'angle entre la normale à la facette et la direction de la source lumineuse éclairant la scène. Cette valeur est constante sur toute la facette, d'où la discontinuité d'ombrage entre les facettes adjacentes.

Là encore, Henri Gouraud a su contourner le problème et mettre à profit la diversité des approches qui étaient étudiées dans son environnement de recherche. « Il faut dire que l'université de l'Utah et en particulier notre département était une vraie pépinière de chercheurs en synthèse d'images » reconnaît-il. Il suivait le cours de traitement du signal du professeur Thomas Stockham. Celui-ci s'intéressait à la façon dont la rétine traite les images, avant de les envoyer au cerveau. Il supposait, à juste titre, qu'une meilleure compréhension de ces phénomènes permettrait d'améliorer l'affichage des images numériques, sur l'écran de l'ordinateur.

« Les théories de Thomas Stockham m'ont permis de voir les choses sous un autre angle (presque sans jeu de mot), reconnaît Henri Gouraud. J'ai compris que la rétine travaillait toujours à faire surgir le détail dans une image : un minuscule point dans une image blanche, les frontières entre les facettes... c'est d'ailleurs la raison pour laquelle diminuer leur taille était illusoire, puisque non seulement cela pénalisait les temps de calcul, mais il aurait aussi fallu aller au delà de la résolution de l’écran pour s'en affranchir. C’est cela qui m'a donné l'idée de teinter les facettes, de façon à estomper leurs arêtes, redonner une continuité visuelle à l'image. » Il fallait y penser.

|

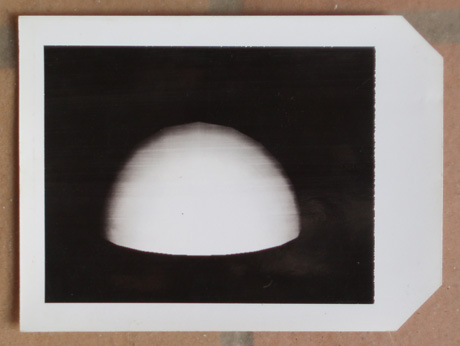

Premier Polaroïd qu'Henri Gouraud a montré à Ivan Sutherland. |

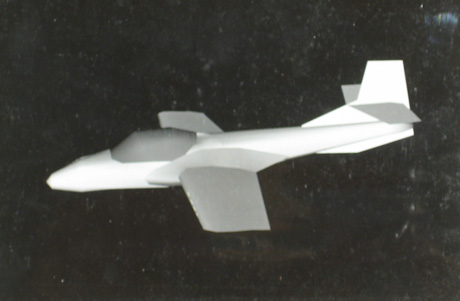

La suite est allée très vite : un rapide essai sur l'image d'une sphère avec le logiciel de Gary Watkins modifié pour prendre en compte cette nouvelle méthode d’ombrage. « On ne voyait plus les facettes, se rappelle Henri Gouraud. J'ai montré ce résultat à Ivan Sutherland, mais il m'a surtout conseillé de me remettre au travail... à la conception, manipulation d'objets... à la CAO plutôt qu'au rendu des images qui n’était effectivement pas le thème central de mon travail ! » Ce n'est qu'un mois ou deux plus tard qu'Ivan Sutherland revient vers lui, pour savoir si sa technique serait aussi adaptée à des objets complexes, comme une structure d'avion. « Pourquoi pas, lui répond-il : il suffit d'avoir sa géométrie, de la définir avec des facettes ! » Chose faite rapidement, sur une maquette d'avion, dont ils mesurent les coordonnées, les entrent dans l'ordinateur, et l'image s'affiche à l'écran...

|

Polaroïd de la maquette d'avion qui a convaincu Ivan Sutherland. |

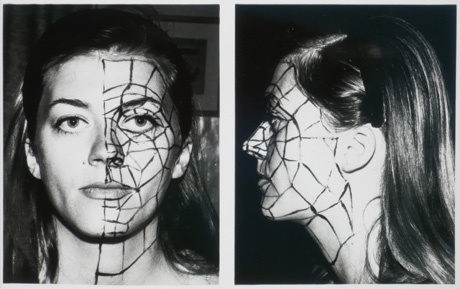

« C'est cette photo qui a été le déclic ! » se rappelle t-il. « Cela vaut un PhD, m'a dit Ivan Sutherland. Rédige cette idée, ce sera le sujet de ta thèse. » Un peu incrédule, compte-tenu de la simplicité technique et mathématique, Henri Gouraud couche son idée sur le papier. Une excellente idée, comme le confirmera la suite, justement parce qu'elle apporte une solution simple à un problème qui paraissait compliqué. D'ailleurs, pour explorer les limites de sa technique, Henri Gouraud n'a pas hésité à prendre son épouse comme modèle ! « Quoi de plus compliqué à reproduire qu'un visage ? » rétorque-t-il. Un soir, elle a donc accepté de servir la science : il lui a peint des lignes sur le visage au crayon noir, il a mesuré les sommets des polygones et entré le tout dans l'ordinateur. Les images du visage de Sylvie Gouraud, façonnées par l'ordinateur selon l'ombrage de son mari, ont ainsi été publiées dans de nombreuses revues et ont figuré en bonne place au Musée de l'informatique de Boston (Mountain View aujourd'hui).

Henri Gouraud inventa par l'interpolation linéaire toute simple et ajouta le coordonnée I à ceux existant X,Y,Z pour le sujet de sa thèse dirigé à l'Utah university, ce qui a pour effet de lisser les facettes d'un objet tout comme le fit plus précisemment l'algorythme de Phong

|

|

Visage de Sylvie Gouraud pendant le relevé de points. |

|

|

|

Reconstruction des facettes à l'ordinateur, à gauche, puis lissage avec ombrage de Gouraud, à droite. |

|

En quoi consiste exactement cette fameuse technique d'ombrage ? « C'est un lissage sur la surface de chaque facette, explique son auteur : mon algorithme calcule l'éclairement local de l'objet pour chaque sommet des facettes, et le répartit pixel par pixel sur la facette en l’interpolant entre chaque sommet. » Concrètement, on commence par interpoler les valeurs de l'éclairement sur les frontières des facettes à partir des éclairements calculés de façon exacte aux sommets. Puis on calcule les valeurs de l'éclairement en chaque pixel de la facette par interpolation des éclairements calculés sur ses frontières. Cet algorithme, contrairement aux solutions précédentes, utilise donc un calcul qui n'est pas uniquement basé sur la facette, mais prend en compte les facettes adjacentes en calculant une moyenne de leurs valeurs d'éclairement, ce qui rend les arêtes entre facettes voisines (presque) imperceptibles.

Pour la première fois, surtout, les chercheurs en synthèse d'image se libèrent de la géométrie pure de l'objet et effectuent sur l’image un travail créatif visant à en améliorer le réalisme. De nombreux thésards ont poursuivi dans cette voie, pendant plusieurs années. C'est d'ailleurs l'un d'entre eux, Bui Tuong Phong, un français d'origine vietnamienne qui venait de l'INRIA, qui a donné le nom d'« ombrage de Gouraud » à cette technique. « Je l'avais baptisé « smooth shading » autrement dit ombrage lisse par opposition à l'ombrage plat (flat shading) à base de facettes de teinte uniforme, précise Henri Gouraud. Bui Tuong Phong a publié sa thèse en 1973 sur une technique plus complexe, qui améliorait encore le rendu en traitant correctement l'effet produit par la réflexion des sources lumineuses. Pour la différencier de la mienne, il les a baptisées respectivement « ombrage de Gouraud (Gouraud shading) » et « ombrage de Phong (Phong shading) »... et c'est resté ! »

|

|

|

Le même objet en ombrage plat (à gauche), de Gouraud (au centre), et de Phong (à droite). |

||

Le rendu n'a cessé d'être amélioré ensuite avec le bump mapping (pour donner l'illusion d'un relief granuleux), le texture mapping (pour donner un aspect de texture, peinture)...

On connaît aujourd'hui le succès des images de synthèse. Néanmoins, les utilisateurs actuels (cinéma, CAO, architecture...) ne s'en sont pas emparés d'emblée. « Il y avait un vrai décalage entre nos travaux d'informaticiens et ces utilisateurs, explique Henri Gouraud. Un concepteur de carrosserie comme Pierre Bézier, que je suis allé voir avec mes images, n'était absolument pas convaincu de l'intérêt des images à l'écran : il avait besoin de les transformer en une maquette réelle, voir le reflet de la lumière sur sa carrosserie. Et j'avoue qu'on était encore loin des rendus réalistes dont il avait effectivement besoin. » Idem en architecture : les architectes n'envisageaient pas de passer plusieurs jours à relever les coordonnées d'un futur bâtiment et les entrer dans l'ordinateur. Peu de clients étaient prêts à en payer le prix. Il a fallu attendre les premiers logiciels de dessin assisté par ordinateur, comme AutoCAD en 1982, qui ont rapidement imposé les modèles 3D et leur intérêt pour le métré des matériaux et les calculs de structures.

C'est en fait l'industrie aéronautique qui a pris les devants en matière de CAO. Là encore, la compétence des ingénieurs français en représentation mathématique des objets était reconnue. Le logiciel le plus réputé, Catia, développé dans les années 1970 par Avions Marcel Dassault pour ses propres besoins, est ensuite devenu le cœur de métier de Dassault Systèmes, filiale créée en 1981. Commercialisé par IBM, Catia est depuis 1984 le principal outil de CAO de Boeing. Plusieurs milliers d'entreprises l'utilisent dans le monde tant pour la conception mécanique que de systèmes électriques, le design ou la fabrication assistée par ordinateur (FAO). C'est une référence en aéronautique évidemment, mais aussi désormais en architecture - depuis 1995, Frank Gehry a conçu avec Catia la plupart de ses réalisations, comme le Musée Guggenheim de Bilbao – et dans l'industrie automobile où la voiture est totalement reconstituée en images de synthèse, chaque pièce pouvant être tournée, démontée, comme sur un prototype physique. Les ingénieurs peuvent vérifier la disposition des instruments de conduite, la visibilité, l'accès aux pièces mécaniques... On entre alors dans le monde de la réalité virtuelle. Là encore, Ivan Sutherland fut l'un des précurseurs : à la fin des années 1960, il a conçu le premier casque de visualisation asservi aux mouvements de la tête, l'« Ultimate Display ».

Avec quelques autres, c'est aussi lui qui a eu l'idée d'utiliser ces techniques pour le cinéma, au début des années 1980. Mais cela n'a pas abouti. Les premiers films qui comportaient quelques séquences d'animation en trois dimensions sont sortis en 1982 : d'abord « Vol de rêve » de Nadia et Daniel Thalmann, puis « Tron », une production de Walt Disney où une course de moto futuriste est réalisée à partir d'images de synthèse. Les français étaient très présents sur ce terrain et y apportaient une créativité artistique notoire. Les sociétés françaises « pionnières » de l'image de synthèse ont été Sogitec et TDI (Thomson Digital Image), qui développaient du matériel (simulateurs de vol et de conduite, essentiellement pour la défense) mais faisaient aussi un peu de production d'image, et surtout Ex Machina (issue de TDI) et Mac Guff Line (créée il y a un peu plus de 20 ans), spécialisées dans la production d'image.

Le premier film d'animation entièrement en images de synthèse viendra bien plus tard, en 1995, avec « Toy Story » des studios Pixar (cofondé par Ed Catmull, ancien étudiant de l'université de l'Utah). Ils ont développé un « moteur de rendu », baptisé RenderMan, considéré comme l'un des plus performants aujourd'hui. Depuis, les succès n'ont cessé, reléguant en quelques années les films d'animation traditionnelle des Studios Disney au stade d'antiquités : « Shrek » en 2001, « Le monde de Nemo » en 2003, « Ratatouille » en 2007...

C'est seulement à partir des années 1990 que les images de synthèse ont connu un développement fulgurant, notamment grâce à l'évolution du matériel, comme les cartes 3D de Silicon Graphics (dont le fondateur, Jim Clark est aussi un ancien étudiant de l'université de l'Utah) dédiées à des stations de travail haut de gamme. Suivront des cartes 3D pour ordinateur grand public et consoles de jeux vidéos, Nintendo et autres PlayStation dont on connaît le succès. Outre le cinéma et les jeux vidéos, les animations 3D ont aussi conquis le monde de la publicité, les génériques d'émissions, les simulateurs de vol... Elles sont aussi devenues indispensables en médecine, en recherche scientifique, météorologie...

« Aujourd'hui, les images calculées par ordinateur sont difficiles à distinguer des images réelles » se félicite Henri Gouraud. Et de se souvenir qu'il n'y a pas encore si longtemps, le nombre de polygones de Gouraud qu'un ordinateur était capable d'afficher par seconde était un argument de vente des fabricants de cartes graphiques.

Une chose est sûre : si l'ombrage de Gouraud est désormais cantonné à certains modes de fonctionnement spécifiques des applications, lorsque l'image doit être calculée très vite, en temps réel, sur un grand nombre de facettes, cette innovation figure dans tous les manuels d'images de synthèse et elle y restera assurément longtemps.

L'ODYSSÉE DE LA 3D

Fonds de Création Audiovisuelle Contemporaine

Institut National de l'Audiovisuel, France. Résumé (FR) L’Odyssée de la 3D est une anthologie chronologique de films en images de synthèse 3D qui retrace la formidable épopée de cette technique, depuis les pionniers des années soixante-dix jusqu’à la fin du XX siècle. Composée de deux volumes, d’une durée de 85 et 88 minutes, L’Odyssée de la 3D présente les oeuvres ayant marqué le développement des outils infographiques et techniques numériques à travers le monde, ainsi que les créations qui sont à la base d’esthétiques et narrations nouvelles. Toutes les oeuvres de L’Odyssée de la 3D sont extraites du Fonds de Création Audiovisuelle Contemporaine de l’Institut National de l’Audiovisuel (http://www.ina.fr/inatheque/activites/projections/index.fr.html) Mots clés : Images de synthèse tridimensionnelles animées, Art technologique, Simulation numérique, Archives numériques, Cinéma. Abstract (EN)A 3D Odyssey is an anthology of 3D animation films that recall the great epic of this technique, since the pioneers of the seventies until the end of the XX century. Composed of two volumes, of 85 and 88 minutes duration, A 3D Odyssey presents works having marked the development of digital tools and digital techniques throughout the world, as well as creations which are at the base of new aesthetics and narration’s. All works of A 3D Odyssey are extracted from the Funds of Contemporary Audiovisual Creation of the National Institute of Audiovisual (http://www.ina.fr/inatheque/activites/projections/index.fr.html) Keywords : 3D Animation, Technological Art, Digital Simulation, Digital Archives, Cinema.

I. L'Odyssée de la 3D (volume 1) : Évolution des outils et des techniques numériques Les premières expériences d’animation d’images bidimensionnelles (2D), réalisées au début des années soixante-dix, ont montré au monde entier que l’image calculée par ordinateur pouvait se prêter à un propos artistique. Olympiad de Lillian F. Schwartz et Kenneth C. Knowlton (EUA, 1971) a été l’une des premières animations figuratives en synthèse d’images 2D. Cette oeuvre, inspirée des planches photographiques d’Eadweard Muybridge sur l’étude de la locomotion humaine, simule le mouvement de la course d’athlètes stylisés. Deux années plus tard au Canada, le talentueux animateur de dessins animés Peter Foldès réalise le chef d’oeuvre La Faim (Canada, 1973). Ce film montre l’enchaînement d’une suite de métamorphoses complexes au service de la narration du film : un cadre devient boulimique jusqu’à l’obésité avant de finir dévoré par des enfants du tiers monde.

Après la maîtrise du trait et de la simulation de sa mise en mouvement, la synthèse d’images part à la conquête de la troisième dimension. Ed Emshwiller, l’un des premiers artistes venus de l’art vidéo, réalise Sunstone (EUA, 1979) considéré aujourd’hui l’un des films clés de l’art vidéo. Ce film a montré qu’il était possible de synthétiser des textures réalistes ou imaginaires, de les plaquer et de les animer sur des modèles 3D, notamment avec la séquence d'ouverture (l'animation du visage du soleil qui sourit et s’illumine d’une curieuse radiance) ou comme ce cube dont les différentes faces sont habillées avec des textures animées.

Le début des années quatre-vingt a été spécialement fertile pour les développements de systèmes d’animation de modèles 3D. Les recherches vont se diriger alors vers l’animation de personnages, ce qui va orienter la création en images de synthèse vers les films de fiction. Vol de Rêve de Philippe Bergeron, Nadia Magnenat-Thalmann et Daniel Thalmann (Canada, 1982) est l’un de premiers films narratifs en images de synthèse 3D. L’envol de la caméra virtuelle emporte le spectateur dans un voyage à travers les maquettes architecturales filaires de différents pays. Très stylisé, ce film est un hommage aux traits de construction de la structure du modèle filaire, qui sont exprimés avec beaucoup d’émotion visuelle. Cette même année, Steven Lisberger réalise Tron (EUA, 1982) dont l’action se déroule au coeur d’un jeu vidéo. Ce cinéaste est le premier à intégrer dans la mise en scène d’un long métrage des objets et des éléments de décors en images de synthèse 3D. « Les observateurs et les critiques se demandaient s’il s’agissait là du début d’une ère nouvelle dans l’industrie cinématographique. Certains prédisaient déjà que les images de synthèse introduisaient une révolution comparable à celle qui a vu l’avènement du sonore en 1927, avec The Jazz Singer » (Warren, 1987). Aujourd’hui Tron est considéré comme un film culte puisqu’il a consommé la rencontre du cinéma et des images de synthèse 3D. L’Europe n’est pas en reste, avec Maison Vole,

André Martin et Philippe Quéau (France, 1983) ont signé l’un des premiers films français en images de synthèse (voir Fig.1) . Les deux réalisateurs allaient par la suite largement contribuer au développement de ces techniques, notamment en participant activement à la création d’Imagina, devenu aujourd’hui l’un des rendez-vous obligés des professionnels du domaine.

Bio Sensor conçu par Takashi Fukomoto et Hitoshi Nishimura (Japon, 1984) est l’un des premiers films à avoir exploré la voie de la rotoscopie tridimensionnelle pour la simulation de la locomotion animale et humaine. Ce film s’est très vite fait remarquer par les mouvements saisissants d’une panthère mécanique —animée à partir des mouvements d’un félin réel— et des quatre coureurs qui s’élancent vers les quatre points cardinaux —animés à partir des mouvements d’un athlète professionnel—. Au même temps aux Etats-Unis, la publicité américaine Sexy Robot, réalisée par Randy Roberts et produite par Robert Abel & Associates (EUA, 1984), exploite la même technique. Les gracieux mouvements réalistes du robot féminin, issus d’un savant mélange des mouvements d’une danseuse réelle et des processus de synthèse d’images, ont captivé le monde entier.

Fig. 1 : Maison Vole d’André Martin et Philippe Quéau. Production INA, Sogitec Audiovisuel. France 1983. Pendant ce temps, un groupe d’animateurs de l’université de Montréal s’est attaqué à la simulation d’expressions faciales prélevées sur celles d’un visage humain et à l’expérimentation de la modélisation hybride. Le héros de Tony de Peltrie de Philippe Bergeron, Daniel Langlois, Pierre Lachapelle et Pierre Robidoux (Canada, 1985), est le premier personnage 3D hybride —dans tout le sens du terme— puisque sa tête est née dans les mains d’un sculpteur avant d’être saisie numériquement, son corps a été construit avec des techniques de modélisation standard ; et l’animation de son visage est le résultat d’un subtile mélange d’expressions capturées sur un acteur en chair et en os, appliquées par méthode d’animation par keyframe. Ces premières expérimentations de modélisation et d’animation hybride déboucheront quelques années plus tard sur le développement des différents systèmes de capture de mouvements sophistiqués et des systèmes de numérisation.

Le film Luxo Junior de John Lasseter (EUA, 1986), qui évoque les démêlées de deux lampes de bureau avec une balle, montrera très rapidement aux professionnels de la synthèse d'image qu’ils ne pourront plus faire l'économie d'un savoir-faire éprouvé depuis Walt Disney.

Avec ce film, le talentueux animateur John Lasseter va ouvrir la voie aux images de synthèse 3D vers le cinéma d’animation en appliquant les principes fondamentaux de l’animation traditionnelle. Luxo Junior deviendra très vite le film en image de synthèse 3D le plus primé des années quatre-vingts et de ce fait, le plus connu du grand public. Ce film marque le début de l’animation d’objets inspirée des techniques traditionnelles d’animation en volume (objets, marionnettes) et qui sera amplement développée par la suite. « Curieusement, vers les années 1986-1987, les chercheurs se sont aperçus qu'il était plus simple de construire des modèles algorithmiques compliqués, intégrant les propriétés dynamiques et physiques des objets, que d'inculquer à l'ordinateur le véritable talent d'un animateur professionnel (comme celui de John Lasseter).

Ces modèles complexes proches de l'intelligence artificielle, appelés modèles dynamiques ou comportementaux permettent de simuler directement l'animation, à partir d'ordres simples, par opposition à l'animation traditionnelle par dessins clés » (1990). Parmi les films bénéficiant de ces techniques procédurales se trouvent Stanley and Stella in Breaking the Ice de Lary Malone (EUA, 1987) et Eurhythmy de Susan Amkraut et Michael Girard (Pays Bas, 1989) exploitant tous deux l’animation comportementale ; Particle Dreams de Karl Sims (EUA, 1988) qui présente les possibilités illimitées des systèmes de particules pour la simulation de phénomènes naturels ; A Sequence From The Evolution of Form de William Latham (Grande-Bretagne, 1989) qui explore les possibilités multiples de transformations, mutations et métamorphoses générées par l’ordinateur ; Tipsy Turvy de Thomas J. Watson (EUA, 1989) qui expérimente les possibilités de simulation des lois physiques et des principes dynamiques et Panspermia de Karl Sims (EUA, 1990) celles des systèmes de particules, de la simulation dynamique et des algorithmes génétiques.

Par la suite, nous remarquons des auteurs qui commencent à explorer la voie des transformations, des déformations, des mutations et des métamorphoses, principes créés dans différents domaines de l’Art, réinventés plus tard par le dessin animé et que la synthèse d’images s’est finalement réappropriés pour en explorer les possibilités infinies grâce à la simulation numérique. Parmi les oeuvres qui excellent dans l’explorations de ces voies nous avons remarqué les lentes torsions sans fin de La quatrième dimension de Zbigniew Rybczynski (Pologne, 1988), les déformations d’une charmante locomotive « malléable » dans Locomotion de Steve Goldberg (EUA, 1989) et les mutations d’une masse de muscles humains en métal dans In Search of Muscular Axis de Toshifumi Kawahara (Japon, 1990)

Nous constatons dès la fin des années quatre-vingt, l’apparition d’une grande tendance dans la création d’images de synthèse 3D qui utilise l’hybridation d’images d’origines différentes ainsi que l’hybridation de techniques (modélisation, animation), grâce aux développements de la numérisation d’images, de la capture de mouvement et de la numérisation 3D. Technological Threat de Bill Kroyer (EUA, 1988) est l’une des premières animations hybrides à explorer, tout en le questionnant, le mélange de personnages issus du dessin animé de type cartoon et personnages 3D. Le Cirque Conférence de Marc Caro (France, 1989) explore et questionne les dimensions spatiales entre l’univers bidimensionnel de l’image traditionnelle et l’espace tridimensionnel de la synthèse d’images 3D, tout en mélangeant personnages réels et virtuels. Finalement, The Abyss de James Cameron (EUA, 1989) présente le premier « hybride protéiforme» d’un réalisme absolument hallucinant, que l’on pourrait décrire comme un pseudopode liquide composé d’eau de mer aux pouvoirs mimétiques. Ce personnage a été modélisé avec des techniques classiques de synthèse d’images, mais sa tête qui se métamorphose en prenant l’apparence de différents visages humains a été réalisée d’après la réplique numérique des acteurs réels. Son animation, hybride aussi, a été réalisée par keyframe d’après les photographies du visage des acteurs faisant différentes expressions. Ce film marque l’arrivée de nouveaux types de personnages dans le domaine du cinéma, qui vont permettre l’essor de narrations nouvelles.

Nous avons constaté que l’évolution des techniques numériques au cours des années quatre-vingts a favorisé des procédures nouvelles de création, propres à susciter des esthétiques jusqu’à là encore imprévisibles, mais que nous illustrerons dans le deuxième volume de L’Odyssée de la 3D.

II. L'Odyssée de la 3D (volume 2) : Essor d'esthétiques et de narrations nouvelles

Dans l’imagerie de synthèse 3D, pourtant largement influencée par la simulation des techniques traditionnelles, des modes de figuration et des esthétiques bien établies qui ont dominé l’art et la culture occidentale pendant de longs siècles, nous avons remarqué l’oeuvre de quelques artistes qui ont poussé l’exploration de la spécificité des techniques numériques, afin d’offrir de nouvelles propositions esthétiques à la synthèse d’image 3D. Le deuxième volume de L’Odyssée de la 3D met en avant des réalisations innovantes d’un point de vue esthétique, tant en ce qui concerne l’image et la narration. Ces « perles rares » donnent déjà une idée des préoccupations et des recherches esthétiques en synthèse d’images 3D. Au début des années quatre-vingt-dix James Cameron, avec son Terminator 2 (EUA, 1991), ouvre la voie à une nouvelle génération de personnages que nous qualifions d’« hybrides protéiformes », et qui seront à l’origine de nouvelles narrations cinématographiques. Après ses premiers essais avec le pseudopode de The Abyss (EUA, 1989), son robot T1000 est capable de se transformer en prenant n’importe quelle forme. La variabilité et la mouvance de la figure (mi-image, mi-objet) illustre l’inépuisable et la multiplicité, la mutation de formes rendue possible par la flexibilité du matériau numérique. Pour la première fois dans l’histoire des effets spéciaux cinématographiques un acteur réel est numérisé et doté d’un double virtuel, d’aspect entièrement chromé.

Quelques années plus tard Steven Spielberg avec Jurassic Park (EUA, 1993), met en scène des dinosaures plus vrais que nature au point que le spectateur finit par se laisser convaincre que la réalité se déroule sous ses yeux et qu’il n’est pas face à des monstres « fabriqués » (avec des techniques traditionnelles). Ce film marque la consécration des images de synthèse 3D pour la création de personnages. Dès lors le cinéma aura la possibilité de tout montrer : des animaux sauvages capables de se plier à la volonté du réalisateur (Jumanji de Joe Johnston, EUA, 1995), des personnages imaginaires donnant la réplique à des acteurs réels (Casper de Brad Siberling, EUA, 1995), voire des personnages ultra réalistes à morphologie humaine . L’arrivée de ces nouveautés est-elle susceptible de libérer le cinéma du réalisme des effets spéciaux en le dirigeant vers de nouveaux défis centrés autour de l’écriture cinématographique ?

Le scénario de la trilogie de The Matrix d’Andy et Larry Wachowski (EUA, 1999-2003) n’est-il pas la preuve d’une volonté de raconter des histoires en mettant en scène les préoccupations que suscitent les technologies numériques ?

Parmi les films d’auteurs tirant précisément profit des possibilités techniques de l’infographie tridimensionnelle pour développer des spécificités visuelles pertinentes et réellement novatrices, nous avons sélectionné la série Ils sont là, les Quarxs de Maurice Benayoun (France, 1993), l’animation Walking Around de César Cabañas (Espagne, 1995), la publicité NTT Data 97 d’Alain Escalle et Taiei Lee (France-Japon, 1997), la fiction Gas Planet d’Eric Darnell (EUA, 1992) et le vidéo-clip Alex Gopher « The Child » d’Antoine Bardou-Jacquet (France, 1999). Les Quarxs est la première série d'animation entièrement en images de synthèse 3D à développer un univers spécifique qui n'avait de sens qu'avec l'image de synthèse, trop complexe pour l'animation traditionnelle, inimaginable en images réelles et dépourvues de sens en bande dessinée. Cet univers étrange, à la fois réaliste et fantastique, nous présente des créatures bizarres qui défient les lois de la nature, ce qui fonde leur existence.

Leurs formes, mouvements et modes de fonctionnement singuliers bouleversent la banalité de l’univers quotidien, qui est représenté d'une manière suffisamment réaliste pour que le spectateur ne s'interroge pas sur son statut et puisse centrer son attention sur cette animalerie fantastique, rigoureusement classée, répertoriée, numérotée et étiquetée. Walking around de César Cabañas (Espagne, 1995), bien qu’il suive la logique de l'animation traditionnelle en volume style pâte à modeler, présente un espace instable, mouvant et malléable, en constante mutation, exploitant au mieux les possibilités de la simulation numérique. Construit sous forme d’un ordinaire parcours linéaire dont le point de départ est une terrasse de café et le point d’arrivée une maison, le héros se voit jouer différents tours perfides par cet espace mutant sous couvert d’une apparence banale.

Les transformations et les déformations subies par le personnage principal, défiant les lois de la physique, n’auraient jamais pu être réalisés avec des techniques traditionnelles de pâte à modeler et elles auraient été totalement dépourvues d’intérêt en dessin animé classique.

La publicité NTT Data 97 d’Alain Escalle et Taiei Lee (France-Japon, 1997) est une composition picturale temporelle jouant avec des objets fétiches du peintre surréaliste espagnol Salvador Dali. Il ne s’agit pas de peinture au sens traditionnel du terme puisque la simulation numérique offre la possibilité de donner vie à des univers picturaux, par nature, figés dans le temps. Gas Planet d’Eric Darnell (EUA, 1992) est un merveilleux exemple des possibilités du rendu non-photoréaliste (NPR), domaine en plein développement en ce moment.

Ces images observées en détail sont frappantes car il ne s’agit pas de peinture réelle, numérisée et plaquée sur les surfaces des modèles 3D, mais d’un nouveau rendu pictural spécifique aux techniques numériques, impossible à rendre avec des techniques graphiques et picturales traditionnelles. Le vidéo-clip Alex Gopher « The Child » d’Antoine Bardou-Jacquet (France, 1999), construit exclusivement avec de la typographie plate, exploite des éléments de l’animation traditionnelle en papier découpé mais dans un espace 3D. Merveilleusement conçu, ce vidéoclip montre un univers concevable et réalisable uniquement en images de synthèse 3D.

Nous avons sélectionné également un ensemble d’oeuvres qui explorent les possibilités de création de l’hybridation d’images hétérogènes, de techniques et d’outils numériques.

L’univers d’Ex Memoriam de Bériou (France, 1992) comme celui de tous les films de ce prolifique réalisateur hybride, est d’une grande richesse visuelle. Nous y retrouvons de nombreux éléments provenant de sources différentes (images 2D, 3D, réelles) et qui s'y mélangent. Ses films demeurent inclassables. L’animateur vidéaste Marc Caro, l’un des premiers artistes à explorer l’envers et revers des possibilités de l’outil numérique et de l’hybridation depuis les années quatre-vingt, excelle avec K.O. Kid (Marc Caro, France, 1992). Ce film de fiction mêlant personnages réels, personnages virtuels plats, mi-image miobjet, le tout dans un espace 3D, met en avant les conséquences des mécanismes de la démesure (ubris) : l’hypertrophie des membres de deux boxeurs lorsqu’ils échangent d’impressionnants coups de poings. Bien évidemment ces déformations excessives défient les lois physiques et des matériaux traditionnels. D’un autre côté, la chorégraphie Totempol de N+N Corsino (France, 1994) rend hommage à l’hybridation en mélangeant des danseurs virtuels stylisés, à des danseurs réels.

Le générique Coupe Du Monde FIFA 98 de Marc Tatou, Antoine Lantieri (France, 1998) joue avec les possibilités spécifique de l’aléatoire en tant que mode de création numérique, tout en mélangeant des images photographiques et des vidéos. L’animation The Simpsons «Treehouse of Horror VI » de David Silverman (GrandeBretagne, 1995) explique avec beaucoup d’humour les caractéristiques et spécificités propres au dessin animé, et à l’image de synthèse 3D, et illustre ainsi les possibilités de l’hybridation numérique. La fiction The End de Chris Landreth (Canada, 1995) et le générique Hommage à Jessie Owens & Carl Lewis de Pitof (France, 1996) explorent les possibilités de l’animation hybride. Quelques artistes ont créé des films hybrides défiant les lois de la perspective de la Renaissance, en recalculant celle-ci avec des lois qui leur sont propres et en proposant donc des modes de figuration originaux. Parmi ces rares films nous trouvons The Garden de Tamás Waliczky (Allemagne 1992) et Faux Plafond de François Vogel (France, 1999). Festival de Yoichiro Kawaguchi (Japon, 1991) et Cahin Caha de Michel Bret (France, 1996) sont deux exemples représentatifs d’oeuvres artistiques explorant les possibilités de l’animation procédurale et comportementale.

Ces techniques qui n’ont rien à voir avec les techniques traditionnelles, sont profondément novatrices mais difficiles à mettre en oeuvre pour le commun des artistes, analphabètes de la programmation. Elles utilisent des programmes complexes de création automatique de formes, de couleurs et de mouvements. En conclusion, nous voyons se confirmer les deux aspects paradoxaux de l’image de synthèse propres à la simulation. D’une part, des réalisations qui cherchent à simuler au plus près les techniques et les esthétiques traditionnelles et qui y arrivent, non sas succès parfois, mais qui pour la plupart ne produisent rien de fondamentalement original, et d’autre part des réalisations novatrices qui veulent explorer et développer ce que le numérique porte en soi de spécifique par rapport aux techniques traditionnelles.

Références Ouvrages:

KERLOW, Isaac Victor (2000). The art of 3-D computer animation and imaging. New York : John Wiley & Sons.

MASSON, Terrence (1999). CG 101 : A computer graphics industry reference. Indianapolis : New Riders.

DE AGUILERA Miguel, VIVAR Hi Hipólito (1990). La infografía. Las nuevas imágenes de la comunicación audiovisual en España.

Le livre d'Imagina. 10 ans d'images de synthèse. Paris : INA, Festival de télévision de Monte Carlo, La documentation française. Madrid : Fundesco, 1990.

Périodiques:

WARREN, Franklin (1987). Lucasfilm : un scénario pour le futur. Dossiers de l’Audiovisuel 15, septembre-octobre 1987, 21.

HISTORY TIMELINE OF COMPUTER GRAPHICS

lthough Looker (1981) was the first film with shaded 3D com puter graphics, Tron (1982) was the first with 15 minutes of computer animation and lots of shaded graphics. Some believe Tron's box office failure slowed the adoption of digital effects, but now most films include computer graph ics. Indeed, last year, of the top 10 box office films, eight had hundreds of digital effects shots or were created entirely with 3D computer graphics. During the past two decades, CG inventors have been in spired by filmmaking to create exciting new tools. In so doing, they have in spired filmmakers to expand the art of filmmaking-as you can see on the following pages. What's next? CG tools move downstream. Synergy gets energy. |

||

(The date at the beginning of each caption refers to the issue of Computer Graphics World in which the image and credit appeared. The film's release date follows the caption.) |

||

July 1982 For this one-minute "Genesis effect" during Star Trek II: The Wrath of Khan, a dead planet comes to life thanks to the first cinematic use of fractals, particle effects, and 32-bit RGBA paint software from Lucasfilm's Pixar group. (Premiere: 6/82) |

||

April 1982 When Disney's Tron was envisioned, few companies knew how to create CG effects, yet the film needed all-digital shots inside a videogame. Although now recognized as landmarks, the visual effects created by MAGI, Triple-I, Robert Abel & Associates, and Digital Effects are ignored by the Motion Picture Academy of Arts and Sciences' Visual Effects Branch. (Premiere: 7/82) |

||

July 1982 Creating the dark, futuristic vision of LA in Blade Runner is accomplished using model shots and painted backgrounds. Several different kinds of software systems help generate computer-controlled camera moves on stage by, for example, fitting motion curves to selected key frames. (Premiere: 6/82) |

||

October 1983 For Star Wars: Episode VI: Return of the Jedi, Lucasfilm's Computer Division creates one effect: a wire-frame "holographic" model of the Death Star under construction. The division evolves into two groups, Games and Pixar. Pixar is sold to Steven Jobs in 1986. (Premiere: 5/83) |

||

July 1984 For The Last Starfighter, Digital Productions creates CG spaceships, planets, and high-tech hardware that are integrated into live-action scenes. |

||

May 1986 Arguably, the first 3D character in a feature film is a knight who leaps out of a stained glass window in Young Sherlock Holmes. The Pixar group at Lucasfilm uses new motion blur technology and its 32-bit RGBA paint system to create the effect. (Premiere: 12/85) |

||

October 1989 Using Alias/2 animation software running on SGI's 4D/120 workstation, Pixar's RenderMan running on a Pixar Image Computer, and data from Cyberware's scans, ILM creates the water tentacle for The Abyss. Storyboards are scanned into SuperMac's PixelPaint and edited with not-yet-released software called Photoshop. (Premiere: 8/89) |

||

August 1990 To animate these skeletons for Total Recall, Metrolight Studios tries using motion capture on set, but this first attempt to use mocap in a film fails. Instead, the studio rotoscopes film shot in low light during the capture. The visual effects win a special achievement Academy Award. (Premiere: 6/90) |

||

October 1991 Director Jim Cameron develops Terminator 2, which doesn't simply include CG but relies on it for the liquid-metal, shape-shifting T-1000 character, which is modeled, animated, rendered, and morphed at ILM. (Premiere: 10/91) |

||

December 1991 Although 3D graphics debuted in earlier Disney animations, Beauty and the Beast is the first in which hand-drawn characters appear in a 3D background. Every frame of the film is scanned, created, or composited within Disney's computer animation production system (CAPS) co-developed with Pixar. (Premiere: (11/91) |

||

April 1992 To create 20 minutes of The Lawnmower Man's version of VR, Angel Studios, Xaos, Inc., and Homer & Associates use motion capture, particle systems, algorithmic-based paint, and other state-of-the-art techniques running on SGI workstations. (Premiere: 3/92) |

||

December 1993 When ILM's Dennis Muren convinces Stephen Speilberg to use computer graphics dinosaurs as well as animatronics in Jurassic Park, movies are forever changed. In ILM's 80 effects shots, full-size dinosaurs move freely in background plates, and the first digital double gets lunched. (Premiere: 6/93) |

||

December 1993 Rather than train a real whale to leap to freedom in the open seas, VIFX inserts a CG whale between shots of animatronics for Free Willy. The CG orca is created with Symbolics software and hardware and rendered with RenderMan. (Premiere: 7/93) |

||

July 1994 For The Lion King, Disney Feature Animation's CGI department animates crowds of 3D wildebeests and integrates them into painted backgrounds, and Disney unveils its closely guarded computer animation and production system (CAPS), co-developed with Pixar. (Premiere: 6/94) |

||

July 1994 Rarely have CG effects been used in as lively a way as the Tex Avery-style ones created by ILM for The Mask. The studio helps turn Jim Carrey into a live-action cartoon and does odd things with his dog, too. (Premiere: 7/94) |

||

June 1995 Casper is arguably the first 3D lead character in a live-action film and definitely the first 3D lead character animated at ILM. ILM creates 200 effects shots for the film, many of which integrate semi-transparent characters into live-action backgrounds. (Premiere: 6/94) |

||

January 1996 Following the success of the CG dinosaurs in Jurassic Park, ILM is asked to produce numerous realistic CG animals for Jumanji, including monkeys and a lion, which causes the studio to develop custom software to create, animate, and render monkey and lion fur, and long hair for the lion's mane. (Premiere: 12/95) |

||

August 1996 To create the tornado for Twister, ILM develops a custom interface for Wavefront's Dynamation to generate controllable, rotating funnels of particles, and a special-purpose particle renderer that runs on SGI's Challenge. (Premiere: 5/96) |

||

August 1997 Although the background is a miniature set, the cars are CG. Digital Domain creates digital effects for The Fifth Element with Power Animator, Softimage 3D, Prisms, RenderMan and, for LeeLu's reincarnation, data from the Visible Human project. (Premiere: 5/97) |

||

September 1997 Many of the 218 visual effects shots created at Tippett Studios for Starship Troopers are filled with crowds of huge, evil, alien bugs. The team uses Softimage 3D, Dynamation, Amazon 3D Paint, and Photoshop. Also, a custom "Bug Input Device" allows puppeteers to animate the 3D warrior bugs in real time. (Premiere: 11/97) |

||

January 1998 Digital Domain, the lead studio on Titanic, breaks new ground by putting thousands of digital people, animated with the help of motion capture, onboard the ship. The studio also creates CG set extensions and digital water. The film receives an Oscar for visual effects, and goes on to earn more money than any other film to date. (Premiere: 12/97) |

||

July 1998 By becoming the second studio to create a successful feature animation with 3D computer graphics, PDI helps ensure the future of the new medium. For Antz, the studio creates new crowd and water-simulation systems and muscle-based facial animation tools. (Premiere: 10/98) |

||

November 1998 With A Bug's Life, Pixar shows the world that its first 3D animated feature, Toy Story, wasn't a fluke. Like the first, this Disney/Pixar film is also a box office hit. For this film, the technical team develops new lighting techniques and methods for defining, painting, and rendering surfaces that help give the bugs and their world a brilliant, translucent look. (Premiere: 11/98) |

||

May 1999 When the effects team at Manex Visual Effects creates this "Bullet Time" shot for The Matrix, little do they know it will inspire similar effects in dozens of future films and help this film win an Oscar for best visual effects. To freeze time for the shot, the team uses an array of cameras; for background buildings, they use image-based modeling. (Premiere: 3/99) |

||

May 1999 To create The Mummy's Imhotep, ILM uses a combination of models and displacement maps that carve the geometry. To move him, the team uses a Vicon8 motion capture system and key frame animation; procedural animation manages the internal organs and dangling bits of decayed flesh. (Premiere: 5/99) |

||

January 1999 In Mighty Joe Young, the gorilla himself is at times a CG character created at ILM or Dream Quest Images. (The shot above is created at ILM.) Both studios develop custom hair-raising software for the film: Dream Quest's code plugs into Maya; ILM's works with its in-house CARI. (Premiere: 12/98) |

||

June 1999 To help create Star Wars Episode I: The Phantom Menace, ILM fashions 1900 visual effects shots for director George Lucas, many of which include such CG main characters as Jar Jar Binks and Boss Nass, shown here. (Premiere: 5/99) |

||

July 1999 Using Disney's Deep Canvas, background artists painted on 2D plots of 3D scenes. Information about each brushstroke was stored and later applied to positions in 3D space, giving the title character in Tarzan ample room to swing through a painterly 3D jungle. (Premiere: 6/99) |

||

July 1999 Some 10 visual effects companies, including Digital Domain, Manex Visual Effects, and Mass Illusions, help create the complex, non-photorealistic, and often surrealistic effects for What Dreams May Come, which wins an Oscar for best visual effects. (Premiere: 9/98) |

||

November 1999 For Warner's cel animation The Iron Giant, a 3D CG hero is created in Maya, rendered as a cartoon in RenderMan, and then imported into Cambridge Animation Systems' Animo. (Premiere: 7/99) |

||

November 1999 Having created the first feature animation with 3D computer graphics in 1995-the wildly successful Toy Story-Pixar then creates a wildly successful sequel, Toy Story 2, which has an emotionally deeper story, 10 times the visual complexity of the first film, and improved human characters. (Premiere: 11/99) |

||

December 1999 Surprisingly, the first photorealistic CG star in a live-action film is not a man but a mouse acting like a child. Imageworks creates the furry star of Stuart Little and costumes him with the help of Maya Cloth. (Premiere: 12/99) |

||

May 2000 Putting an entire cast of 3D animated characters in a world fabricated from live-action backgrounds has not been attempted before Disney Feature Animation creates a 3D animation facility to do just that for Dinosaur. To assemble the dinosaurs and lemurs, 15 software engineers write 450 programs; more than 120 are plug-ins to Maya and Softimage 3D. (Premiere: 5/00) |

||

June 2000 To transplant the moose and squirrel into The Adventures of Rocky and Bullwinkle, a live-action film, ILM renders 3D characters with a 2D cartoon look while keeping their dimensionality, and finds ways to animate the oddly shaped, formerly hand-drawn characters. (Premiere: 6/00) |

||

July 2000 For Hollow Man, Sony Pictures Imageworks creates a CG clone of Kevin Bacon and causes its skin, muscles, organs, and bones to erode, layer-by-layer, as it becomes invisible. (Premiere: 7/00) |

||

July 2000 Without CG water, it would be impossible to suggest the violence of The Perfect Storm. The effects team at ILM considers the movement of light through a drop of water, generates various types of foam and spray, reproduces the movement of ocean swells and 100-foot waves, and creates CG boats, planes, and digital doubles. The film receives a visual effects Oscar nomination. (Premiere: 6/00) |

||

December 2000 Disney's The Secret Lab creates one spotless digital Dalmatian named Oddball, several spotted CG pups, and wipes the spots off real pups digitally for the film 102 Dalmatians. (Premiere: 12/00) |

||

December 2000 Putting Dr. Seuss's How the Grinch Stole Christmas onto the big screen entails creating CG landscapes and set extensions for the live-action film. Using Houdini, Maya, and RenderMan, Digital Domain also sends a CG sleigh rocketing down a CG mountain and helps populate Who-ville with digital Whos. (Premiere: 11/00) |

||

April 2001 Winner of the first Oscar for best animated feature, DreamWorks/ PDI's irreverent comedy Shrek sends its stars, a cartoony donkey, a story-book princess, and the ogre Shrek on a quest through finely detailed CG landscapes. A gigantic box-office hit, the fractured fairy-tale is PDI's second 3D feature animation. (Premiere: 4/01) |

||

June 2001 By creating CG planes, battleships, smoke, set extensions, water, tracer fire, and digital sailors, ILM simulates the bombing of Pearl Harbor, using new rendering techniques and rigid body simulations for the movie Pearl Harbor. (Premiere: 5/01) |

||

August 2001 Although it fails commercially, Square's ambitious Final Fantasy, which features the first cast of photorealistic digital actors, stirs the imagination of the press and CG community. (Premiere: 7/01) |

||

October 2001 For Monsters, Inc., Pixar's fourth 3D feature and big hit, the animation studio's new simulation engine makes it possible to put a blue-haired monster in nearly every frame of the film. (Premiere: 10/01) |

||